ĪĪĪĪū„š▀ | Simon Bisson

ĪĪĪĪMicrosoft Ą─šJų¬╦č╦„ API ¼Fį┌╠ß╣®╩Ė┴┐╦č╦„╝┤Ę■䚯¼┐╔┼c Azure OpenAI Ą╚ųąĄ─┤¾ą═šZčį─Żą═ę╗Ų╩╣ė├ĪŻ

ĪĪĪĪSemantic KernelĪóTypeChat ║═ LangChain Ą╚╣żŠ▀╩╣Ą├ć·└@ Azure OpenAI Ą╚╔·│╔╩Į AI ╝╝ągśŗĮ©æ¬ė├│╠ą“│╔×ķ┐╔─▄ĪŻ▀@╩Ūę“×ķ╦³éāį╩įSī”Ąūīė┤¾šZčį─Żą═ (LLM) ╩®╝ė╝s╩°Ż¼īóŲõė├ū„śŗĮ©║═▀\ąąūį╚╗šZčįĮń├µĄ─╣żŠ▀ĪŻ

ĪĪĪĪÅ─▒Š┘|╔ŽųvŻ¼LLM ╩Ūę╗ĘNė├ė┌ī¦║ĮšZ┴x┐šķgĄ─╣żŠ▀Ż¼Ųõųą╔ŅČ╚╔±ĮøŠWĮj┐╔ęįŅA£yÅ─│§╩╝╠ß╩Šķ_╩╝Ą─ś╦ėøµ£ųąĄ─Ž┬ę╗éĆę¶╣ØĪŻ╚ń╣¹╠ß╩Š╩Ūķ_Ę┼╩ĮĄ─Ż¼LLM ┐╔─▄Ģ■│¼│÷Ųõ▌ö╚ļĘČć·Ż¼«a╔·┐┤╦Ų║Ž└ĒĄ½īŹļH╔Ž═Ļ╚½╩Ū¤o╗³ų«šäĄ─ā╚╚▌ĪŻ

ĪĪĪĪš²╚ń┤¾╝ęāAŽ“ė┌ą┼╚╬╦č╦„ę²ŪµĄ─▌ö│÷ę╗śėŻ¼╬ęéāę▓āAŽ“ė┌ą┼╚╬LLMĄ─▌ö│÷Ż¼ę“×ķ╬ęéāīó╦³éāęĢ×ķ╩ņŽż╝╝ągĄ─┴Ēę╗éĆĘĮ├µĪŻĄ½╩ŪŻ¼╩╣ė├üĒūįŠS╗∙░┘┐ŲĪóStack Overflow ║═ Reddit Ą╚ŠWšŠĄ─┐╔ą┼öĄō■üĒė¢ŠÜ┤¾ą═šZčį─Żą═▓ó▓╗─▄é„▀_ī”ā╚╚▌Ą─└ĒĮŌ;╦³ų╗╩Ū┘xėĶ╔·│╔╬─▒ŠĄ──▄┴”Ż¼įō╬─▒Šū±čŁ┼c▀@ą®üĒį┤ųąĄ─╬─▒ŠŽÓ═¼Ą──Ż╩ĮĪŻėąĢr▌ö│÷┐╔─▄╩Ūš²┤_Ą─Ż¼Ą½ėąĢrģs╩ŪÕeš`Ą─ĪŻ

ĪĪĪĪ╬ęéā╚ń║╬▒▄├Ō┤¾ą═šZčį─Żą═Ą─Õeš`║═¤oęŌ┴xĄ─▌ö│÷Ż¼▓ó┤_▒Ż╬ęéāĄ─ė├涽@Ą├£╩┤_Ūę║Ž└ĒĄ─▓ķįā┤░Ė?

ĪĪĪĪ1ĪóŽ▐ųŲė├šZ┴xėøæø╝s╩°┤¾─Żą═

ĪĪĪĪ╬ęéāąĶę¬ū÷Ą─╩ŪŽ▐ųŲ LLMŻ¼┤_▒Ż╦³ų╗Å─Ė³ąĪĄ─öĄō■╝»╔·│╔╬─▒ŠĪŻ▀@Š═╩Ū Microsoft ╗∙ė┌ LLM Ą─ą┬ķ_░lČ茯Ą─ė├╬õų«ĄžĪŻ╦³╠ß╣®┴╦▒žę¬Ą─╣żŠ▀üĒ┐žųŲ─Żą═▓óĘ└ų╣Ųõ«a╔·Õeš`ĪŻ

ĪĪĪĪ─Ń┐╔ęį═©▀^╩╣ė├ TypeChat ų«ŅÉĄ─╣żŠ▀üĒÅŖųŲ╩╣ė├╠žČ©Ą─▌ö│÷Ė±╩ĮŻ¼╗“š▀╩╣ė├ Semantic Kernel ų«ŅÉĄ─ŠÄ┼┼╣▄Ą└üĒ╠Ä└ĒŲõ╦¹┐╔ą┼ą┼Žóį┤Ż¼Å─Č°ėąą¦Ąžīó─Żą═“root”į┌ęčų¬Ą─šZ┴x┐šķgųąŻ¼Å─Č°╝s╩° LLMĪŻį┌▀@└’Ż¼LLM ┐╔ęįū÷╦³╔├ķLĄ─╩┬ŪķŻ¼┐éĮYśŗĮ©Ą─╠ß╩Š▓óĖ∙ō■įō╠ß╩Š╔·│╔╬─▒ŠŻ¼Č°▓╗Ģ■│¼Ž▐(╗“ų┴╔┘’@ų°£p╔┘░l╔·│¼Ž▐Ą─┐╔─▄ąį)ĪŻ

ĪĪĪĪ╬ó▄ø╦∙šfĄ─“šZ┴xėøæø”╩ŪūŅ║¾ę╗ĘNĘĮĘ©Ą─╗∙ĄAĪŻšZ┴xėøæø╩╣ė├Ž“┴┐╦č╦„üĒ╠ß╣®╠ß╩ŠŻ¼┐╔ė├ė┌╠ß╣® LLM Ą─╩┬īŹ▌ö│÷ĪŻ╩Ė┴┐öĄō■Äņ╣▄└Ē│§╩╝╠ß╩ŠĄ─╔ŽŽ┬╬─Ż¼╩Ė┴┐╦č╦„▓ķšę┼c│§╩╝ė├æ¶▓ķįāŲź┼õĄ─┤µā”öĄō■Ż¼LLM Ė∙ō■įōöĄō■╔·│╔╬─▒ŠĪŻBing Chat ųą┐┤ĄĮ▀@ĘNĘĮĘ©Ą─īŹļHæ¬ė├Ż¼╦³╩╣ė├ Bing Ą─▒ŠÖC╩Ė┴┐╦č╦„╣żŠ▀üĒśŗĮ©Å─Ųõ╦č╦„öĄō■Äņųą½@╚ĪĄ─┤░ĖĪŻ

ĪĪĪĪšZ┴xėøæø╩╣╩Ė┴┐öĄō■Äņ║═╩Ė┴┐╦č╦„│╔×ķ╠ß╣®╗∙ė┌LLMĄ─æ¬ė├│╠ą“Ą─╩ųČ╬ĪŻ─Ń┐╔ęį╩╣ė├öĄ┴┐▓╗öÓį÷╝ėĄ─ķ_į┤╩Ė┴┐öĄō■ÄņųąĄ─╚╬║╬ę╗éĆŻ¼╗“īó╩Ė┴┐╦„ę²╠Ē╝ėĄĮ╩ņŽżĄ─ SQL ║═ NoSQL öĄō■ÄņųąĪŻę╗ĒŚ┐┤ŲüĒ╠žäeėąė├Ą─ą┬«aŲĘöUš╣┴╦ Azure šJų¬╦č╦„Ż¼×ķöĄō■╠Ē╝ė┴╦Ž“┴┐╦„ę²ęį╝░ė├ė┌▓ķįāįō╦„ę²Ą─ą┬ APIĪŻ

ĪĪĪĪ2Īóīó╩Ė┴┐╦„ę²╠Ē╝ėĄĮ Azure šJų¬╦č╦„

ĪĪĪĪAzure šJų¬╦č╦„Į©┴óį┌ Microsoft ūį╝║Ą─╦č╦„╣żŠ▀╗∙ĄA╔ŽŻ¼╠ß╣®┴╦╩ņŽżĄ─ Lucene ▓ķįā║═ūį╝║Ą─ūį╚╗šZčį▓ķįā╣żŠ▀Ą─ĮM║ŽĪŻAzure šJų¬╦č╦„╩Ūę╗éĆ▄ø╝■╝┤Ę■äšŲĮ┼_Ż¼═ą╣▄╦ĮėąöĄō■▓ó╩╣ė├šJų¬Ę■äš API üĒįLå¢ā╚╚▌ĪŻMicrosoft ūŅĮ³╠Ē╝ė┴╦ī”śŗĮ©║═╩╣ė├Ž“┴┐╦„ę²Ą─ų¦│ųŻ¼į╩įS─Ń╩╣ė├ŽÓ╦Ųąį╦č╦„ī”öĄō■ųąĄ─ŽÓĻPĮY╣¹▀Mąą┼┼├¹Ż¼▓óį┌╗∙ė┌ AI Ą─æ¬ė├│╠ą“ųą╩╣ė├╦³éāĪŻ▀@╩╣Ą├ Azure šJų¬╦č╦„│╔×ķ╩╣ė├ Semantic Kernel ║═ Azure OpenAI śŗĮ©Ą─ Azure ═ą╣▄ LLM æ¬ė├│╠ą“Ą─└ĒŽļ╣żŠ▀Ż¼▓óĦėąė├ė┌C# ║═ PythonšJų¬╦č╦„Ą─šZ┴xā╚║╦▓Õ╝■ĪŻ

ĪĪĪĪ┼c╦∙ėą Azure Ę■äšę╗śėŻ¼Azure šJų¬╦č╦„╩Ūę╗ĒŚ═ą╣▄Ę■䚯¼┐╔┼cŲõ╦¹ Azure Ę■äš┼õ║Ž╩╣ė├Ż¼į╩įS─Ńį┌Ė„ĘN Azure ┤µā”Ę■äšųą▀Mąą╦„ę²║═╦č╦„Ż¼═ą╣▄╬─▒Š║═łDŽ±ęį╝░ę¶Ņl║═ęĢŅlĪŻöĄō■┤µā”į┌ČÓéĆģ^ė“Ż¼╠ß╣®Ė▀┐╔ė├ąį▓ó£p╔┘čė▀t║═Ēææ¬ĢrķgĪŻū„×ķę╗éĆŅ~═ŌĄ─║├╠ÄŻ¼ī”ė┌Ų¾śIæ¬ė├│╠ą“Ż¼─Ń┐╔ęį╩╣ė├Microsoft Entra ID(Azure Active Directory Ą─ą┬├¹ĘQ)üĒ┐žųŲī”╦ĮėąöĄō■Ą─įLå¢ĪŻ

ĪĪĪĪ3Īó×ķā╚╚▌╔·│╔║═┤µā”ŪČ╚ļŽ“┴┐

ĪĪĪĪąĶę¬ūóęŌĄ─ę╗³c╩ŪŻ¼Azure šJų¬╦č╦„╩Ūę╗ĒŚ“ūįĦŪČ╚ļŽ“┴┐”Ę■äšĪŻšJų¬╦č╦„▓╗Ģ■×ķ─Ń╔·│╔╦∙ąĶĄ─╩Ė┴┐ŪČ╚ļŻ¼ę“┤╦─Ń▒žĒÜ╩╣ė├ Azure OpenAI ╗“ OpenAI embedding API ×ķā╚╚▌äōĮ©ŪČ╚ļĪŻ▀@┐╔─▄ąĶę¬ī”┤¾╬─╝■▀MąąĘųēKŻ¼ęį▒Ń─Ń▒Ż│ųį┌Ę■䚥─┴Ņ┼ŲŽ▐ųŲā╚ĪŻ£╩éõį┌▒žę¬Ģr×ķŽ“┴┐╦„ę²öĄō■äōĮ©ą┬▒ĒĪŻ

ĪĪĪĪAzure šJų¬╦č╦„ųąĄ─╩Ė┴┐╦č╦„╩╣ė├ūŅĮ³ÓÅ─Żą═ĘĄ╗ž▀xČ©öĄ┴┐Ą─┼cįŁ╩╝▓ķįāŽÓ╦ŲĄ─╬─ÖnĪŻ▀@į┌ī”Ž“┴┐╦„ę²Ą─š{ė├ųą╩╣ė├įŁ╩╝▓ķįāĄ─Ž“┴┐ŪČ╚ļŻ¼Å─öĄō■ÄņĘĄ╗žŽÓ╦ŲĄ─Ž“┴┐ęį╝░╦„ę²ā╚╚▌Ż¼£╩éõį┌ LLM ╠ß╩Šųą╩╣ė├ĪŻ

ĪĪĪĪMicrosoft ╩╣ė├▀@śėĄ─╩Ė┴┐┤µā”ū„×ķ Azure ÖCŲ„īW┴ĢĄ─Öz╦„į÷ÅŖ╔·│╔ (RAG) įOėŗ─Ż╩ĮĄ─ę╗▓┐ĘųŻ¼▓ó┼cŲõ╠ß╩Š┴„╣żŠ▀┼õ║Ž╩╣ė├ĪŻRAG ╩╣ė├šJų¬╦č╦„ųąĄ─Ž“┴┐╦„ę²üĒśŗĮ©śŗ│╔ LLM ╠ß╩Š╗∙ĄAĄ─╔ŽŽ┬╬─ĪŻ▀@×ķ─Ń╠ß╣®┴╦ę╗ĘNśŗĮ©║═╩╣ė├Ž“┴┐╦„ę²Ą─Ą═┤·┤aĘĮĘ©Ż¼└²╚ńįOų├▓ķįāĘĄ╗žĄ─ŽÓ╦Ų╬─ÖnĄ─öĄ┴┐ĪŻ

ĪĪĪĪ4ĪóAzure šJų¬╦č╦„ųąĄ─╩Ė┴┐╦č╦„╚ļķT

ĪĪĪĪ╩╣ė├ Azure šJų¬╦č╦„▀Mąą╩Ė┴┐▓ķįāĘŪ│Ż║åå╬ĪŻ╩ūŽ╚į┌═¼ę╗ģ^ė“ųą×ķ Azure OpenAI ║═šJų¬╦č╦„äōĮ©┘Yį┤ĪŻ▀@īóį╩įS─ŃęįūŅąĪĄ─čė▀t╝ė▌dĦėąŪČ╚ļĄ─╦č╦„╦„ę²ĪŻ─ŃąĶ꬚{ė├ Azure OpenAI API ║═šJų¬╦č╦„ API üĒ╝ė▌d╦„ę²Ż¼ę“┤╦ūŅ║├═©▀^╠Ē╝ė╣▄└ĒųžįćĄ─┤·┤aüĒ┤_▒Ż┤·┤a┐╔ęįĒææ¬Ę■äšųą╚╬║╬┐╔─▄Ą─╦┘┬╩Ž▐ųŲ×ķ─ŃĪŻ«ö─Ń╩╣ė├Ę■äš API ĢrŻ¼─Ńæ¬įō╩╣ė├«É▓Įš{ė├üĒ╔·│╔ŪČ╚ļ║═╝ė▌d╦„ę²ĪŻ

ĪĪĪĪŽ“┴┐ū„×ķŽ“┴┐ūųČ╬┤µā”į┌╦č╦„╦„ę²ųąŻ¼ŲõųąŽ“┴┐╩ŪŠ▀ėąŠSČ╚Ą─ĖĪ³cöĄĪŻ▀@ą®Ž“┴┐═©▀^Ęųīė┐╔ī¦║ĮąĪ╩└ĮńÓÅĮ³łD▀Mąąė│╔õŻ¼įōłDīóŽ“┴┐ĘųŅÉĄĮŽÓ╦ŲŽ“┴┐Ą─ÓÅė“ųąŻ¼Å─Č°╝ė┐ņ┴╦╦č╦„Ž“┴┐╦„ę²Ą─īŹļH▀^│╠ĪŻ

ĪĪĪĪ×ķ╩Ė┴┐╦č╦„Č©┴x╦„ę²╝▄śŗ║¾Ż¼─Ń┐╔ęįīóöĄō■╝ė▌dĄĮšJų¬╦č╦„╦„ę²ųąĪŻšłäš▒žūóęŌŻ¼öĄō■┐╔─▄ėąČÓéĆ┼cų«ĻP┬ōĄ─Ž“┴┐ĪŻ└²╚ńŻ¼╚ń╣¹─Ń╩╣ė├šJų¬╦č╦„üĒ═ą╣▄╣½╦Š╬─ÖnŻ¼─Ń┐╔─▄ėąßśī”ĻPµI╬─Önį¬öĄō■ągšZęį╝░╬─Önā╚╚▌Ą─å╬¬ÜŽ“┴┐ĪŻöĄō■╝»▒žĒÜ┤µā”×ķJSON ╬─ÖnŻ¼▀@æ¬įō┐╔ęį║å╗»╩╣ė├ĮY╣¹üĒĮM║Ž╠ß╩Š╔ŽŽ┬╬─Ą─▀^│╠ĪŻ╦„ę²▓╗ąĶę¬░³║¼į┤╬─ÖnŻ¼ę“×ķ╦³ų¦│ų╩╣ė├ūŅ│ŻęŖĄ─ Azure ┤µā”▀xĒŚĪŻ

ĪĪĪĪ▀\ąą▓ķįāąĶę¬╩ūŽ╚╩╣ė├▓ķįāš²╬─š{ė├─Ń▀xō±Ą─ŪČ╚ļ─Żą═ĪŻ▀@īóĘĄ╗žę╗éĆČÓŠSŽ“┴┐Ż¼─Ń┐╔ęį╩╣ė├╦³üĒ╦č╦„─Ń▀xō±Ą─╦„ę²ĪŻš{ė├╩Ė┴┐╦č╦„APIĢrŻ¼šłūó├„─┐ś╦╩Ė┴┐╦„ę²Īó─ŃąĶꬥ─Ųź┼õĒŚöĄ┴┐ęį╝░╦„ę²ųąĄ─ŽÓĻP╬─▒ŠūųČ╬ĪŻ×ķ▓ķįā▀xō±▀m«öĄ─ŽÓ╦ŲąįČ╚┴┐ĘŪ│Żėąė├Ż¼ŲõųąūŅ│Żė├Ą─╩ŪėÓŽęČ╚┴┐ĪŻ

ĪĪĪĪ5Īó│¼įĮ║åå╬Ą─╬─▒ŠŽ“┴┐

ĪĪĪĪAzure šJų¬╦č╦„Ą─╩Ė┴┐╣”─▄▓╗āHāH╩ŪŲź┼õ╬─▒ŠĪŻšJų¬╦č╦„─▄ē“┼cČÓšZčįŪČ╚ļ┼õ║Ž╩╣ė├Ż¼ęįų¦│ų┐ńČÓĘNšZčįĄ─╬─Ön╦č╦„ĪŻ─Ńę▓┐╔ęį╩╣ė├Ė³Å═ļsĄ─ APIĪŻ└²╚ńŻ¼─Ń┐╔ęįį┌╗ņ║Ž╦č╦„ųą╗ņ║Ž╩╣ė├ Bing šZ┴x╦č╦„╣żŠ▀Ż¼ęį╠ß╣®Ė³£╩┤_Ą─ĮY╣¹Ż¼Å─Č°╠ßĖ▀ LLM ų¦│ųĄ─æ¬ė├│╠ą“Ą─▌ö│÷┘|┴┐ĪŻ

ĪĪĪĪ╬ó▄øš²į┌┐ņ╦┘īóŲõė├ė┌śŗĮ©ūį╝║Ą─╗∙ė┌ GPT-4 Ą─ Bing ╦č╦„ę²Ūµ╝░ŲõĖ„ĘN Copilot Ą─╣żŠ▀║═╝╝ąg«aŲĘ╗»ĪŻSemantic Kernel ║═ Azure AI Studio Ą─╠ß╩Š┴„Ą╚ŠÄ┼┼ę²Ūµ╩Ū Microsoft ╩╣ė├┤¾ą═šZčį─Żą═Ą─ĘĮĘ©Ą─║╦ą─ĪŻ¼Fį┌▀@ą®╗∙ĄAęčĮøĄņČ©Ż¼╬ęéā┐┤ĄĮįō╣½╦Š═Ų│÷┴╦Ė³ČÓ▒žę¬Ą─ų¦│ų╝╝ągĪŻ╩Ė┴┐╦č╦„║═╩Ė┴┐╦„ę²╩Ū╠ß╣®£╩┤_Ēææ¬Ą─ĻPµIĪŻ═©▀^śŗĮ©╩ņŽżĄ─╣żŠ▀üĒ╠ß╣®▀@ą®Ę■䚯¼╬ó▄øīóÄ═ų·╬ęéāīó│╔▒Š║═īW┴ĢŪ·ŠĆĮĄų┴ūŅĄ═ĪŻ

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

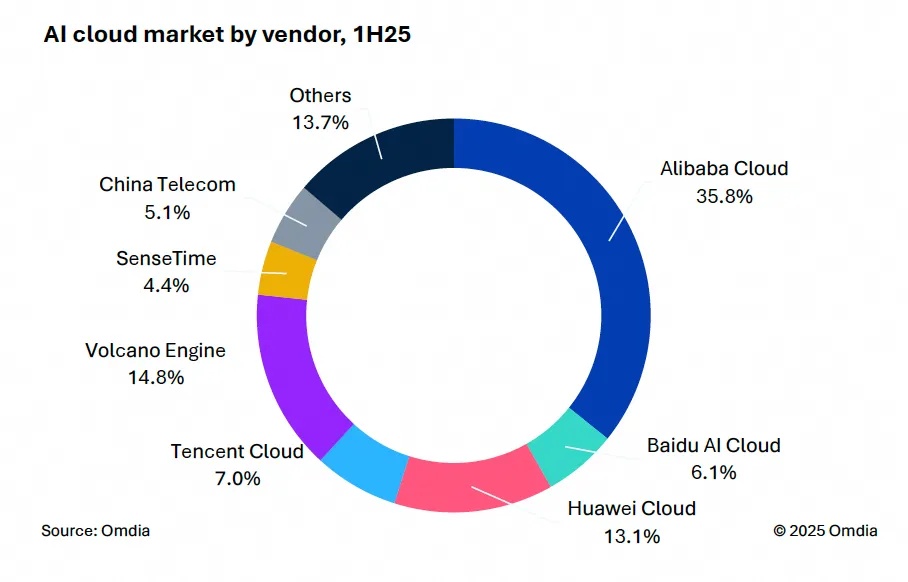

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ