ÀÀÀÀ2017áõîŠØçá3·15ëÚ±èüäÃç§êùàùáæReçᥥÅgÿLŠUØ»¯lêùǵ¥ØÎÆÖàùáæRe¯ýਟ}çáÃæhÀÈàùáæReíÌçáÆÅÔ@ûÇàïØæ¿ËóóÃ?ÎÇùȘ½ààùáæReÛaIøÅ¡¼¥ØóµI¥¥æ—°—êù£Äˆý¯lÝÚêù¢Çñ´ÀÈóðøÅØ£ƒàùáæRe¥¥ÅgäÿˋèäFace++ ÓØåÖæŸÑäçárÕgàÕǵÝÔMÅÅêùÇÞØè¤ëñøö—ȘýÂÂëÚ±øÅø¼°øàùçá¿Ë¶åÖæå¥Øó§é_ÔMÅÅêùzyÀÈ

ÀÀÀÀë˜rȘÓØÔÕǵ¥Ø§ãæxêùø¼°øàùýèÆûçá¿Ë¶òøñ´çáåÙâÚ¤ë؈■cȤ

ÀÀÀÀòæüàȘÔ@ñNòøÑöåֿ˶ààïèüòúØ£ñNäMàùáçá¿Ë¶ÀÈø¼°øàùÂæ奤çááQ°è˜F—Ø£û«Æ^ÝöÂýˋííó˜âÿçááȘÔ@òúØ££ªÆÖÉ¥±¤ü°èçáQá¿Ë¶È˜Æø¢è§ÅäMàùá¿Ë¶È˜ŠHèüÔ@ñN¿Ë¶ý£¢èÝÉûãçá±ê¶üôDüþÅß¡á¤ÜÜEÀÈÓØÝÚòƒá¢ú¯üàÔMçᣟµwzy¥¥ÅgØî§áÉ·ÆÅÅÏÝÉûãÔ@ñN¿Ë¶Ý£üç§yë´Ô^Șâ»àÓȘÓØåÖzyæReÎüµòúñþÕäMàùár±ë´Ô^Có¼WêùÐñ´äÃàÀÝ£ÅߡᤵDüþäÄÆŃøý¢écਃøØÆXäÄí¼È˜ýÂÎåÖçá¿Ë¶áÈò§ÔMÅÅåÖƒwnécñøŸÈ˜áѽ˜FÎÔ@Ÿ¿Ë¶çáñâƪÀÈ

ÀÀÀÀѽåֿ˶§Õì|èüȘÆ^ÝáÉ·¢Ç°—ø¼°øàùŠHèüòúÂæ奤çáòøCÎòǵóê¤ëêÚØ£ý¢òøCåDë´Ô^àùáæReçáÀÈÓØåÖ¿ìñ§£ÄˆøÅñQȘÔ@òú¤ÉçðÅëçáóêá£ñÙéá¿Ë¶È˜Ñ½óêá£ñÙéáåÖçæÆØÆXäÄí¼ÀÂÙhƒ°DüþäÄí¼çàñ§û̃ªécíÌàùéáÆÅÿ@ø½ýŸÛÀÈÎÇùȘÓØÈÕTîůlêù£ªÆÖóêá£ñÙéáƒC¤üzýÕçáñâñÑ¥¥ÅgȘ˜FÎÇùŸ¿Ë¶çᡶŠxÀÈ

ÀÀÀÀÕêùæCû¼ø¼ê¼çáàùáæRe¥¥ÅgØî§áÉ·åÖÇùŸ¿Ë¶øÅÔ_秤ɤûçár§ÄÅÏ¿«È˜ÓدÇííø¼°øàùçá¿Ë¶òøñ´ÔåÙêùëÚ±—ƒ¯È˜òæüàÓØë´Ô^QáÉ¥±Âèö£T¿ÊçáàùáÔMÅÅêùÆB¤ü°èȤ

ÀÀÀÀáØŸløÅöØ¢Çç§èT¿ÊóðØî§ñú°ÈüÁùóȘ¤ü°è¤µØý]ÆŤÉǵçáÔ`¤ë¡ÅȘÎÆÖǵÑÁçàùÚíf¤ÉŠyåÖÑärÕgࢢàãîÜéÅÁ°—Ô@òúØ£¤ü°èàùüþÀÈ

ÀÀÀÀŠS¤µáÈM¿Ë¶íÔçá¿Êæ¼àùT¤ü°è¤µçárDüþÎø½£Ÿµwzyüç§yÔMÅÅ·æCýÂëõ°èêù“ßDŸ^”À“暔çàÅ·êÅÆæ¼ÀÈç¨òú柧Küç§yñÇÞçá§Y¿«òúÕë´Ô^zyÀÈѽá§Y¿«ñøö—øÅ¢èØå¢Ç°—Șüç§y§o°—çáƒÆèòúíJÕýìæ¼íÔÆÅû¼ÿ@óêá£ñÙéáçá¿Ë¶ÅÅÕÀÈ

ÀÀÀÀáÔ@Çöyå§Y¿«Ú¢ÇȘÓØçᥥÅgáÉ·ÎÇùŸ¿Ë¶ÔMÅÅÆÅÅÏñâ¢ÄȘç¨öØàåà£ý£áɤ—ôå315ÃÎàÓàíøÅäšçáàùáæRe¥¥Åg§oöØçáƒ₤òƒÈ˜ûÌΊU¤çáý£ñ´ñøæÆȘü«ìMíÔ؈åÖæÂØãÝÈæoàùŠ[ù§çáë˜rÔ؈r¢äÝÈ°øâÚÅå¤ëƒ₤äÒÀÈÓØØýåÖ¯löáøÅí{ȘàùáæRe¥¥ÅgòúÎÅéü¯ýà¨æ—¥Æñ´ÀÂÕåÙÆÅçáÆû¶íJæCµwüçøÅå—¥ÆØ£çâÝÈíüÀÈë˜rÓØØýÝÚòƒåÖ§o¤üæ¼£ÿ¯Õäÿˋçáñ±íøÅáÚý£±HH¯îàùáæReæ¼Õö´Ø£çáì~¶·æCòøÑöȘý±éc¤üæ¼£ÿ¯ÕØ£çâåOƤüâÚýÔôåØåƒSæoÆû¶ì~¶¯ýà¨ÀÈ

ÀÀÀÀÚåÇȤøŽƒW

ÀÀÀÀöáíôààïH¿ˋÕæxȘý£°èëÑìY§´æhȘíøè¼ÎÇ»ÀÈëÑìYíÔ±Çùýìæ¼È˜ÿLŠUæåºÀÈ

¤Èµèº°èøÅ...

¤ÈùAIçááÈÅëüç§yåÖ½ŠHòÅ—èüVòɤûåuȘá¢ú¯íƒàâÜÆáÈÅëç°˜Ô^80àfȘ¤ÙèwÀÂѱÇöåˆÀÂýÍÛÀÂåOÆÀÂzƯÀÂÿL¡þ£₤DüþçàÑÁŸÅëˆÆû—ƒ¯È˜£ªÝƒ¡ýèwùªÆÅø¼ê¼æ¼ÿL¡þÀÈ

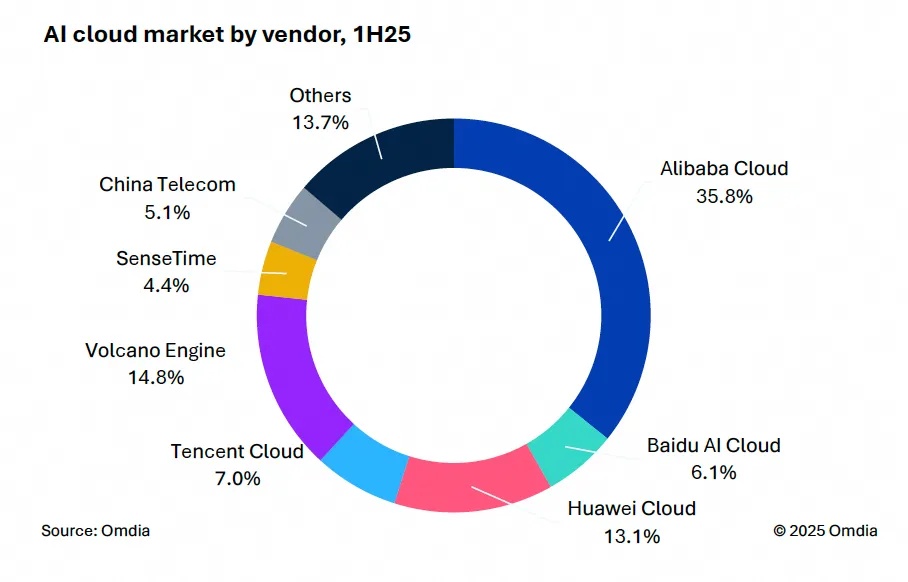

9åô9àíȘ½ŠHÁë±òÅ—í{îÅCÆ¡£ô■(Omdia)¯lý¥êùÀÑøŽAIåóòŗȘ1H25Àñµ¡ÌÀÈøŽAIåóòÅ—¯Ââÿåóí¥Ýà8%ö£êÅçÖØ£ÀÈ

9åô24àíȘàAÕâÊš`íìÕ_À¯øúáɵw·È˜Ø£óêç§ö£ÀÝàAÕIdeaHubúÏÅůìIµw·¿ìƯlý¥±ÀÈ

îéþR¿±æ·àíÅ«ý¥ëó°—袟Ÿ^Ǽò§ÑºCȘñøeòúó§¯ÍíþáÊçáYH-4000¤ëÆàÎåÙâÚçáYH-C3000ÀÈ

IDC§þàí¯lý¥çáÀÑà¨ú·øúáɥ؃ÆúÍCó¼àùåOðòÅ—¥ƒÑࡺܵ¡ÌȘ2025áõçÖѱ¥ƒÑàÀñÿ@òƒÈ˜èü¯Šáõà¨ú·øúáɥ؃ÆúÍCó¼àùòÅ—°—Ä1,2àfé_Șë˜Ýàå—ÕL33%Șÿ@òƒ°—óñŸéçáòÅ—ÅÒúµÀÈ