ĪĪĪĪ╣╚ĖĶ DeepMind ═Ų│÷╚½ą┬Ą─ęĢėX - šZčį - äėū„─Żą═(VLA)Ż¼├³├¹×ķ Robotic Transformer2(RT-2)ĪŻ▀@éĆ─Żą═┐╔ęį┼cÖCŲ„╚╦╗źäėŻ¼═©▀^īW┴ĢŠWĮj║═ÖCŲ„╚╦öĄō■Ż¼īóų¬ūR▐D╗»×ķėąą¦Ą─ųĖ┴ŅĪŻ

ĪĪĪĪRT-2╩Ū RT-1Ą─╔²╝ē░µŻ¼╗∙ė┌ Transformer śŗĮ©Ż¼Š▀ėąĖ³║├Ą─ąį─▄║═Ę║╗»─▄┴”ĪŻRT-2▀Ćį┌ę╗ŽĄ┴ąĄ─Č©ąį║═Č©┴┐īŹ“×ųąš╣╩Š│÷¾@╚╦Ą─īW┴Ģ║═└ĒĮŌ─▄┴”Ż¼─▄ē“ł╠ąą╗∙▒Š═Ų└Ē║═ČÓļAČ╬Ą─šZ┴x═Ų└ĒĪŻ═©▀^┼c╦╝ŠSµ£═Ų└ĒĮY║ŽŻ¼RT-2┐╔ęįīW┴ĢķLŲ┌ęÄäØ║═Ą═╝ē╝╝─▄Ż¼ł╠ąąĖ³Å═ļsĄ─├³┴ŅĪŻ

ĪĪĪĪ蹊┐╚╦åTė^▓ņĄĮŻ¼┼cų«Ū░Ą─╗∙ŠĆ─Żą═ŽÓ▒╚Ż¼RT-2Ą─Ę║╗»ąį─▄╠ßĖ▀┴╦3▒Čęį╔ŽĪŻRT-2Ą─│╔╣”š╣╩Š┴╦ęĢėXšZčį─Żą═▐D╗»×ķęĢėXšZčįäėū„─Żą═Ą─Øō┴”Ż¼×ķśŗĮ©═©ė├īŹ¾wÖCŲ„╚╦╠ß╣®┴╦Ū░Š░ĪŻ

ĪĪĪĪšō╬─ĄžųĘ:https://robotics-transformer2.github.io/assets/rt2.pdf

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

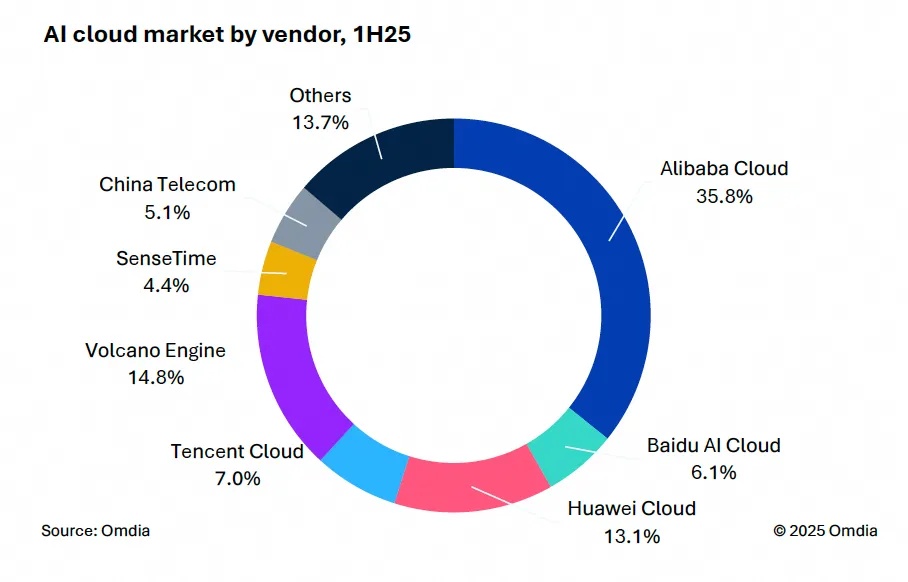

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ