ĪĪĪĪ╬─ Ż³ ĪČųąć°┐ŲīWł¾ĪĘ ėøš▀ ═§Ļ╗Ļ╗

ĪĪĪĪ├µ╩└▓╗ĄĮę╗─ĻĄ─ChatGPTŻ¼ę²░l┴╦┤¾─Żą═Ģr┤·ūāĖ’Ż¼į┌ŽŲŲėųę╗▓©╚╦╣żųŪ─▄(AI)└╦│▒Ą─═¼ĢrŻ¼ę▓ĦüĒ┴╦ą╣┬®ļ[╦ĮĪóę²░l“’ł═ļĮ╣æ]”Īó░Ą▓žŪųÖÓ’LļUĄ╚ę╗ŽĄ┴ąå¢Ņ}ĪŻ

ĪĪĪĪChatGPTęį╝░░┘Č╚╬─ą─ę╗čįĪóėŹ’wąŪ╗šJų¬┤¾─Żą═Ą╚Ą─│÷¼FŻ¼ś╦ųŠų°╚╦╣żųŪ─▄▀M╚ļą┬░lš╣ļAČ╬ĪŻĄ½┼c┤╦═¼ĢrŻ¼ĪČ┐ŲīWĪĘĪČūį╚╗ĪĘĄ╚Ų┌┐»╝Ŗ╝Ŗ░l╬─Ż¼ųĖ│÷╚╦╣żųŪ─▄═■├{ų°┐ŲīWĄ─═Ė├„Č╚ĪŻČÓć°Į╠ė²▓┐ķTę▓╝Ŗ╝Ŗ│÷┼_š■▓▀Ż¼Į¹ų╣į┌īWąŻ╩╣ė├ChatGPTĪŻ

ĪĪĪĪį┌╬ęć°Ż¼īW╬╗Ę©▓▌░Ė▓╗Š├Ū░╠ßšł╩«╦─ī├╚½ć°╚╦┤¾│Ż╬»Ģ■Ą┌╬Õ┤╬Ģ■ūh│§┤╬īÅūhĪŻ▓▌░Ėī”īW╬╗½@Ą├š▀└¹ė├╚╦╣żųŪ─▄┤·īæīW╬╗šō╬─Ą╚ąą×ķŻ¼├„┤_┴╦ŽÓæ¬Ą─Ę©┬╔ž¤╚╬Ż║ĮøīW╬╗įuČ©╬»åTĢ■īÅūhøQČ©ė╔īW╬╗╩┌ėĶå╬╬╗│ĘõNīW╬╗ūCĢ°ĪŻ╚╗Č°Ż¼į┌īŹļH▓┘ū„ųąŻ¼└¹ė├╚╦╣żųŪ─▄┤·īæīW╬╗šō╬─▀@ŅÉīWąg▓╗Č╦ąą×ķ╚ń║╬▓ķūC?▀@ą®īWąg▓╗Č╦ąą×ķ║═▀mČ╚▀\ė├╚╦╣żųŪ─▄Ą─│▀Č╚ś╦£╩ėų╚ń║╬ĮńČ©?

ĪĪĪĪ¼FĀŅŻ║

ĪĪĪĪį┌“╗ņüy”ųą╗┼├”æ¬ī”

ĪĪĪĪChatGPTęč├µ╩└┤¾░ļ─ĻŻ¼╦³ī”īWągĮń║═Į╠ė²ĮńŠ┐Š╣«a╔·┴╦į§śėĄ─ė░Ēæ?

ĪĪĪĪĮ±─Ļ1į┬Ż¼├└ć°─│ŠWšŠ░l╬─ĘQŻ¼ChatGPT▓┼│÷¼Fā╔éĆį┬Ż¼Š═ęčįņ│╔┴╦ļyęįčįė„Ą─╗ņüyĪŻĪČųąć°┐ŲīWł¾ĪĘėøš▀╩ß└Ē░l¼FŻ¼īWągĮń║═Ė▀ąŻĖ³ČÓĄ─╩Ūį┌č█╗©┐ØüyĄ─æ¬ė├ł÷Š░│÷¼F║¾Ż¼▓┼│÷┼_š■▓▀Ż¼é}┤┘“æ¬æ”ĪŻ

ĪĪĪĪį┌īWągĮńŻ¼Į±─Ļ1į┬Ż¼ĪČ┐ŲīWĪĘų„ŠÄ╦„Ųšęį╔ńšōą╬╩Į░l╬─ĘQŻ¼ChatGPTęč│╔×ķę╗ĘN╬─╗»▐ZäėŻ¼ī”┐ŲīWĮń║═īWągĮńįņ│╔ć└ųžė░ĒæŻ¼▓ó▒Ē╩Š╚╦éāį┌ūŅĮ³Ą─蹊┐ųą░l¼FŻ¼┤¾┴┐ė╔ChatGPTäōĮ©Ą─šō╬─š¬ę¬▒╗╠ßĮ╗ĮoīWągīÅĖÕ╚╦ĪŻ

ĪĪĪĪ╦„ŲššfŻ¼ĪČ┐ŲīWĪĘš²į┌Ė³ą┬ŠÄ▌ŗęÄätŻ¼ÅŖš{▓╗─▄į┌ū„ŲĘųą╩╣ė├ė╔ChatGPT(╗“╚╬║╬Ųõ╦¹╚╦╣żųŪ─▄╣żŠ▀)╔·│╔Ą─╬─▒ŠĪóöĄūųĪółDŽ±╗“łDą╬ĪŻ╦¹╠žäeÅŖš{Ż¼╚╦╣żųŪ─▄│╠ą“▓╗─▄│╔×ķū„š▀ĪŻ

ĪĪĪĪ░³└©ĪČūį╚╗ĪĘĪČ╝Ü░¹ĪĘĪČ┴°╚~ĄČĪĘĄ╚į┌ā╚Ą─ųTČÓ┐ŲīWŅÉŲ┌┐»ę▓Č╝░l▓╝┴╦┤¾¾wę╗ų┬Ą─ęÄätĪŻ

ĪĪĪĪĖ▀ąŻ╩▄ĄĮĄ─ė░Ēæ╦Ų║§Ė³┤¾ĪŻ

ĪĪĪĪĮ±─Ļ│§Ż¼├└ć°╦╣╠╣ĖŻ┤¾īWĄ─ę╗ĒŚĘŪš²╩Į├±ęŌš{▓ķ’@╩ŠŻ¼įōąŻėą┤¾┴┐īW╔·ęčĮøį┌Ų┌─®┐╝įćųą╩╣ė├┴╦ChatGPTĪŻ═¼ĢrŻ¼ĪČĖŻ▓╝╦╣ĪĘ░l╬─ĘQŻ¼89%Ą─īW╔·│ąšJ╩╣ė├ChatGPTū÷╝ę═źū„śIŻ¼Ųõųą48%Ą─īW╔·│ąšJ╩╣ė├ChatGPT▀Mąą╝ę═ź£yįć╗“£y“ׯ¼53%Ą─īW╔·ė├╦³īæ┴╦ę╗Ų¬šō╬─Ż¼22%Ą─īW╔·ė├╦³īæ┴╦ę╗Ų¬šō╬─Ą─┤¾ŠVĪŻėą72%Ą─┤¾īW╔·šJ×ķChatGPTæ¬į┌╦¹éāĄ─┤¾īWŠWĮjųą▒╗Į¹ė├ĪŻ

ĪĪĪĪ“į┌ĘQ┘ØChatGPT╣”─▄ÅŖ┤¾Ą─▒│║¾Ż¼╚╦éāæ¬┐┤ĄĮŲõĮoīWągĮńĦüĒĄ─Į╣æ]┼c┐ų╗┼ĪŻ”ųąć°╚╦├±┤¾īW╩ūČ╝░lš╣┼cæ┬į蹊┐į║Ė▒į║ķL╣∙ėóä”▒Ē╩ŠŻ¼├└ć°ę╗ą®Ė▀ąŻęčīóą┬╝╝ąg╝{╚ļīWągš\ą┼ųąĪŻ╚A╩óŅD┤¾īW║═Ę├╔╠ž┤¾īWĄ╚ęčĮøą▐Ė─┴╦╦³éāĄ─īWągš\ą┼▓▀┬įŻ¼īó╩╣ė├ChatGPTĄ╚╚╦╣żųŪ─▄╣żŠ▀╝{╚ļžŌĖ`Ą╚īWąg▓╗Č╦ĘČć·ĪŻ

ĪĪĪĪī”┤╦Ż¼╣∙ėóä”▒Ē╩ŠŻ¼╚╦╣żųŪ─▄įņ│╔Ą─žŌĖ`ąą×ķį┌«öŽ┬Ą─īWągęÄätųą║▄ļyĄ├ĄĮūC├„ĪŻ▀@ę╗ŽĄ┴ąĄ─žō├µė░Ēæķ_╩╝ūī╚╦éā╦╝┐╝Ż¼╩Ūʱæ¬įōį┌īWągĮń║═Ė▀ąŻĮ¹ė├ChatGPT?

ĪĪĪĪō·ænŻ║

ĪĪĪĪ┼┬īW╔·å╩╩¦¬Ü┴ó╦╝┐╝─▄┴”

ĪĪĪĪ“Ė▀ąŻ╗“īWągĮń╚½├µĮ¹ų╣╚╦╣żųŪ─▄«aŲĘ╩Ū▓╗┐╔─▄Ą─Ż¼ę▓╩Ū─µÜv╩Ę│▒┴„Ą─ĪŻ”ķL╔│└Ē╣ż┤¾īWĮ╠╩┌äóąĪ┤║▒Ē╩ŠŻ¼æ¬ę²ī¦īW╔·š²┤_šJūR║═╩╣ė├╚╦╣żųŪ─▄«aŲĘČ°ĘŪĮ¹ų╣ĪŻøQČ©─▄ʱ╩╣ė├╚╦╣żųŪ─▄▌oų·Ą─ĻPµIŻ¼æ¬╩Ū┼ąöÓŲõŽÓĻP«aŲĘ╩Ūʱ╔µ╝░╩▄Į╠ė²š▀äōą┬─▄┴”Ą─┼ÓBĪŻ

ĪĪĪĪ║■─Ž┤¾īWĘ©īWį║Ė▒į║ķL╩Y║Ż╦╔┼e└²šfŻ¼ChatGPTęč│╔×ķĮ╠ė²ŅIė“Ą─ÅŖ┤¾╣żŠ▀Ż¼▓óĦüĒŅŹĖ▓ąįė░ĒæŻ¼ė╚Ųõī”╦¹╦∙į┌Ą─é„ĮyĘ©┬╔Į╠ė²Ą╚ŅIė“Ą─ø_ō¶Ė³┤¾ĪŻ

ĪĪĪĪChatGPTĄ──Ė╣½╦ŠOpenAI▒Ē╩ŠŻ¼GPT-4į┌┬╔Ĥ┘YĖ±┐╝įć(UBE)ųą┐╔ō¶öĪ90%Ą─┐╝╔·ĪŻį┌ŠW╔Ž▌ö╚ļ“ChatGPTĢ■╚Ī┤·──ą®ŹÅ╬╗”Ą─¤ßķTį~ŚlųąŻ¼Ę©┬╔╣żū„š▀Ė▀Šė░±╩ūĪŻ

ĪĪĪĪ“╝┤▒Ń╚ń┤╦Ż¼╚╦×ķĮ¹ų╣ChatGPT╩Ū║┴¤oęŌ┴xĄ─Ż¼ę▓Ģ■å╩╩¦īWąg▀M▓ĮĄ─ÖCė÷ĪŻ”╩Y║Ż╦╔▒Ē╩ŠŻ¼╩ŪʱĮ¹ė├╚╦╣żųŪ─▄«aŲĘ▓╗─▄ę╗Ė┼Č°šōŻ¼ę¬ĘeśO├µī”ą┬╝╝ąg▀\ė├ĦüĒĄ─ÖCė÷┼c╠¶æŻ¼ę²ī¦īW╔·š²┤_┐┤┤²┐Ų╝╝Ż¼▓ó╝ė┤¾ęÄųŲ┴”Č╚Ż¼īóŲõį┌Į╠ė²┼cīWąg蹊┐ųą┐╔─▄«a╔·Ą─’LļU▒M┐╔─▄ĮĄĄ═ĪŻ

ĪĪĪĪ─Ū├┤Ż¼┐Ųčą╚╦åT║═Į╠Ĥ╩╣ė├╚╦╣żųŪ─▄«aŲĘĄ─▀^│╠ųąėą║╬ę╔æ]?ĪČųąć°┐ŲīWł¾ĪĘėøš▀į┌▓╔įL░l¼FŻ¼Į╠ĤĄ─ō·æn╝»ųąį┌▀^ČÓ╩╣ė├┐╔─▄ī¦ų┬īW╔·å╩╩¦¬Ü┴ó╦╝┐╝─▄┴”ĪŻ

ĪĪĪĪ“╬ęī”ChatGPTĄ─│÷¼F│ų═Ļ╚½ų¦│ųæBČ╚Ż¼ŲĮĢr╩╣ė├▌^ČÓŻ¼╬ęĄ─▓╗╔┘īW╔·ę▓į┌ė├ĪŻ”╣∙ėóä”▒Ē╩ŠŻ¼ChatGPTĄ─╣”─▄┤_īŹ║▄ÅŖ┤¾Ż¼Ą½╦¹║▄ō·ą─īW╔·Įø│Ż╩╣ė├Ģ■«a╔·ę└┘ćŻ¼ī¦ų┬Ųõ╚▒Ę”╦╝▒µąįŻ¼▀@ī”īW╔·Ą─īæū„─▄┴”┼ÓBĄ╚Ģ■║▄▓╗└¹ĪŻ

ĪĪĪĪ╣∙ėó䔚J×ķŻ¼ChatGPTĄ╚╚╦╣żųŪ─▄«aŲĘĄ─│÷¼FŻ¼Š═Ž±╩Ū╦Ń▒PĢr┤·ķ_╩╝│÷¼F┴╦ėŗ╦ŃŲ„Ż¼╗“š▀±R▄ćĢr┤·│÷¼F┴╦ÖCäė▄ćĪŻ▀@ĘNĖ’├³ąįūā╗»╩Ū╚╬║╬╚╦Č╝ūĶō§▓╗ūĪĄ─ĪŻæ¬į╩įS▓óų¦│ųīW╔·Å─ĘeśOĘĮ├µ╩╣ė├╚╦╣żųŪ─▄«aŲĘĪŻ

ĪĪĪĪų┴ė┌īW╔·Ą─æBČ╚Ż¼▒▒Š®└Ē╣ż┤¾īWėŅ║ĮīWį║▓®╩┐╔·╩Y┴┐╩▄įLĢr▒Ē╩ŠŻ¼┐ŲčąųąŻ¼ChatGPT┐╔ū„×ķę╗ĘN╣żŠ▀▌oų·ķ_š╣ŽÓĻP╣żū„Ż¼Ą½čąŠ┐╔·╚įæ¬ęįūį╔Ē¬Ü┴ó╦╝┐╝×ķų„ĪŻ╚╦╣żųŪ─▄┐╔╠ßĖ▀īW┴Ģą¦┬╩Ż¼Ą½▓╗─▄ū„×ķīW┴Ģų„¾wĪŻ“ėą▒žę¬į┌蹊┐╔·┼ÓB▀^│╠ųąŽ▐ųŲChatGPTĄ─╩╣ė├ĪŻ”

ĪĪĪĪ“╬ęéāĢ■▌^ŅlĘ▒Ąžė├ChatGPTŻ¼╬ę░l¼F╦³Ė³Ž±ėą³c‘ąĪ┬ö├„’Ą─īW╔·Ż¼«a╔·Ą─ą┼Žó▓╗ę╗Č©£╩┤_Ż¼Ą½į┌▀ē▌ŗ╔Ž┐╔─▄╩Ūī”Ą─ĪŻ”╩Y┴┐▒Ē╩ŠŻ¼╬┤üĒ╚╦╣żųŪ─▄į┌╦č╝»ą┼ŽóĘĮ├µĄ─ā×ä▌Ģ■ė·╝ė├„’@Ż¼ĻPµI╩ŪęÄĘČ┤╦ŅÉ╣żŠ▀Ą─╩╣ė├Ż¼╩╣Ųõ─▄Ė³║├ĄžÄ═ų·╚╦éāīW┴Ģ║═╦╝┐╝Ż¼ėų▓╗ų▒Įė╠µ┤·╚╦īW┴Ģ║═╦╝┐╝ĪŻ

ĪĪĪĪō■╩Y║Ż╦╔ė^▓ņŻ¼└Ē╣ż┐ŲīW╔·ī”ChatGPTĄ─╩╣ė├Ė³ČÓŻ¼ę▓ėąīW╔·ė├╦³═Ļ│╔▓┐Ęųū„śIĪŻ“ĻPµI╩Ūį┌╩╣ė├▀^│╠ųąłį│ųūįų„╦╝┐╝Ż¼▒Ż│ųŠ»ėX┼cųö╔„Īó║Ž└Ē║ŽęÄ╩╣ė├Ż¼═¼Ģrę¬╝ėÅŖą┼Žó╦žBĄ─┼ÓBŻ¼Įė╩▄╚╦╣żųŪ─▄ŽÓĻPų¬ūRĄ─īW┴Ģ║═┼Óė¢ĪŻ”

ĪĪĪĪųąć°╚╦├±┤¾īWš▄īWį║Į╠╩┌äóė└ų\▒Ē╩ŠŻ¼─┐Ū░┤¾šZčį─Żą═ī”Į╠ė²Ą─ø_ō¶▓┼äéäé’@¼FŻ¼╬┤üĒĢ■ė·č▌ė·┴ęĪŻŠ═ęčĮø▒®┬ČĄ─█EŽ¾┐┤Ż¼╔·│╔╩Į╚╦╣żųŪ─▄īóī”Š═śIĪóĮ╠ė²Īóą┼Žó░▓╚½Ą╚ŅIė“ĦüĒśO┤¾╠¶æŻ¼▀@ą®ŅIė“Č╝┼cĮ╠ė²ŽÓĻPĪŻ╚╦╣żųŪ─▄ą┬«aŲĘī”╚╦╬─╔ń┐ŲŅÉīW┐ŲĄ─Į╠īW┐Ųčąęį╝░╬─┐ŲŅÉŠ═śIŹÅ╬╗ø_ō¶īóĢ■Š▐┤¾Ż¼╚ńęįChatGPT×ķ┤·▒ĒĄ─ūį╚╗šZčį╠Ä└Ē╝╝ąg╔├ķLĖ„ĘN╬─ūųĪóĘŁūgĪóą┼ŽóģR┐é║═ŠÄ│╠Ą╚╣żū„ĪŻ

ĪĪĪĪ“╬┤üĒŻ¼īW╔·īó╔·╗Ņį┌╚╦╣żųŪ─▄▌oų·Ą─ŁhŠ│ųąŻ¼ę“┤╦▓╗įōį┌īWąŻ║═īWągĮńĮ¹ė├ŽÓĻP«aŲĘŻ¼Ę±ät┼ÓB│÷üĒĄ─īW╔·Š═Ģ■┬õ║¾ė┌╔ńĢ■ĪŻ”äóė└ų\▒Ē╩ŠŻ¼ī”ė┌īW╔·║═Į╠Ĥ▀\ė├╚╦╣żųŪ─▄«aŲĘÄ═ų·ŲõīW┴Ģ║═蹊┐Ż¼īWąŻ║═īWągĮńæ¬ųŲČ©╝Üų┬Ą─ųĖī¦ęŌęŖŻ¼ī”ė┌──ą®ė├Ę©▒╗į╩įSĪó──ą®ąĶę¬Į¹ų╣ū„│÷įö╝ÜęÄČ©║═Į©ūhĪŻ▀@ą®ęÄČ©║═Į©ūhꬳį│ų═©ąąĄ─īWągĄ└Ą┬įŁätųĖī¦Ż¼ėųę¬┐╝æ]▓╗ūĶĄKäōą┬ą¦┬╩Ą─╠ßĖ▀ĪŻ

ĪĪĪĪ╬┤üĒŻ║

ĪĪĪĪĮńČ©│▀Č╚║═ś╦£╩

ĪĪĪĪīW╬╗Ę©▓▌░Ėī”└¹ė├╚╦╣żųŪ─▄┤·īæīW╬╗šō╬─Ą╚ąą×ķęÄČ©┴╦ŽÓæ¬Ą─Ę©┬╔ž¤╚╬ĪŻ─Ū├┤ĪŻ┤╦Ū░ė├╚╦╣żųŪ─▄«aŲĘīæšō╬─Ģ■ė|ĘĖĘ©┬╔åß?ėąø]ėąŽÓĻPĘ©┬╔ęÄČ©?

ĪĪĪĪī”┤╦Ż¼╩Y║Ż╦╔▒Ē╩ŠŻ¼└¹ė├╚╦╣żųŪ─▄īæīW╬╗šō╬─▒Š┘|╔Žī┘ė┌īWąg▓╗Č╦ąą×ķĪŻ¼FąąĘ©┬╔Ę©ęÄ┐“╝▄Ž┬Ż¼ė├ChatGPTĄ╚šZčį┤¾─Żą═īæšō╬─Ą─ąą×ķ═¼śė▀`Ę©ĪŻ

ĪĪĪĪ╦¹ĮķĮBŻ¼╚╦╣żųŪ─▄ū„×ķ“╣P╠µ”äōū„Ą─╬─š┬┐╔öMųŲ×ķ“╦¹╚╦┤·īæĄ─ĘČ«Ā”Ż¼▒╗ÜwŅÉ×ķīWąg▓╗Č╦Ą─ĘČ«ĀĪŻĖ∙ō■2016─ĻŅC▓╝Ą─ĪČĖ▀Ą╚īWąŻŅAĘ└┼c╠Ä└ĒīWąg▓╗Č╦ąą×ķ▐kĘ©ĪĘęÄČ©Ż¼ŽÓĻPž¤╚╬╚╦Ģ■╩▄ĄĮ═©ł¾┼·įuĪóĮKų╣╗“š▀│ĘõNŽÓĻP┐ŲčąĒŚ─┐Īó│ĘõNīWąg¬ääŅ╗“š▀śsūuĘQ╠¢Īó▐o═╦╗“ĮŌŲĖĄ╚╠Ä┴PĪŻ

ĪĪĪĪ┤╦┤╬╠ßšłīÅūhĄ─īW╬╗Ę©▓▌░Ė├„┤_Ż¼ęčĮø½@Ą├īW╬╗š▀į┌½@Ą├īW╬╗▀^│╠ųą┤µį┌īW╬╗šō╬─╗“īŹ█`│╔╣¹│ŁęuĪóžŌĖ`Īóé╬įņĪóöĄō■įņ╝┘Īó╚╦╣żųŪ─▄┤·īæĄ╚īWąg▓╗Č╦ąą×ķĄ─Ż¼ĮøīW╬╗įuČ©╬»åTĢ■īÅūhøQČ©Ż¼ė╔īW╬╗╩┌ėĶå╬╬╗│ĘõNīW╬╗ūCĢ°ĪŻ

ĪĪĪĪ“ąĶę¬ūóęŌĄ─╩ŪŻ¼▓▌░Ė┤“ō¶Ą─╩Ū╚╦╣żųŪ─▄┤·īæ▀@ĘNīWąg▓╗Č╦ąą×ķŻ¼Č°▓╗╩ŪųĖ╚╦╣żųŪ─▄Ą─▀mČ╚▀\ė├ĪŻĄ½┤·īæ║═▀mČ╚▀\ė├Ą─│▀Č╚╝░ś╦£╩╚ń║╬ĮńČ©║═äØĘų─┐Ū░╚į╩ŪļyŅ}Ż¼ę¬ĮY║Ž┤▐qĮ╠ĤĪóīWągįuČ©╬»åTĢ■Ą╚Ą─┼ąČ©ĪŻ”╩Y║Ż╦╔▒Ē╩ŠĪŻ

ĪĪĪĪų┴ė┌īW╬╗Ę©▓▌░Ė─▄ʱ╣▄Ą├ūĪīWąg▓╗Č╦Ą╚ąą×ķŻ¼äóąĪ┤║šJ×ķŻ¼▀@╚ĪøQė┌╩ŪʱōĒėąŽÓæ¬Ą─╝╝ąg─▄┴”Öz£yīW╬╗šō╬─╩Ūʱ▓╔ė├┴╦╚╦╣żųŪ─▄äōū„ĪŻäØŪÕ│■“╚╦╣żųŪ─▄▌oų·”║═“╚╦╣żųŪ─▄ų„ī¦äōū„”Ą─ĮńŠĆę▓╩«Ęųųžę¬ĪŻ╚╦ŅÉęčĮø▀M╚ļ┐╔ęįĖ▀ą¦┬╩ĪóĖ▀┘|┴┐½@╚Īų¬ūRĄ──Ļ┤·Ż¼į┌│ŻęÄĄ─╬─½IŠC╩÷Īó╬─½IÖz╦„┼cĘų╬÷─▄┴”ĘĮ├µŻ¼╚╦╣żųŪ─▄īó│¼▀^╚╦ŅÉŻ¼ę“┤╦▀@ą®Łh╣Ø▓▌░Ėæ¬ėĶęį┐╝æ]Īóįö╝ÜęÄČ©ĪŻ

ĪĪĪĪ╦¹▀Mę╗▓ĮĮ©ūhŻ¼į┌šō╬─īæū„▀^│╠ųąŻ¼ĘŪäōįņ┼cäōą┬ŅÉĄ─ų¬ūRģR┐é║═╩ß└Ē╣żū„┐╔ęįį╩įS╩╣ė├╚╦╣żųŪ─▄▌oų·äōū„Ż¼Ą½▒žąĶū„├„┤_éõūó;╔µ╝░šō╬─äōą┬╦╝Žļ║═║╦ą─ā╚╚▌▓┐ĘųĄ─╣żū„Ż¼▓╗į╩įS╩╣ė├╚╦╣żųŪ─▄▌oų·Ż¼Įø╝╝ągĶbČ©ę╗Ą®šJČ©Ż¼æ¬░┤ššīWąg▓╗Č╦ąą×ķ╠Ä└ĒĪŻ

ĪĪĪĪ“ę└šš─┐Ū░ć°ļH╔ŽĄ─═©ąąū÷Ę©Ż¼ęį╝░╬ęī”ć°ā╚Ė▀ąŻĄ─ė^▓ņŻ¼ę¬į┌īW╬╗Ę©▓▌░Ėųąī”╚╦╣żųŪ─▄ę²░lĄ─īWąg▓╗Č╦Ą╚ū÷│÷Š▀ėąĘ©┬╔ęŌ┴x╔ŽĄ─įö╝ÜęÄĘČ╩Ū║▄ļyĄ─ĪŻ”╣∙ėóä”▒Ē╩ŠŻ¼Į¹ų╣╩╣ė├╚╦╣żųŪ─▄┤·īæīW╬╗šō╬─┐┤╦Ų╩ŪäéąįęÄČ©Ż¼Ą½Š▀¾w▓┘ū„ųąĢ■║▄ļy▓ķūCŻ¼¤ošō╩Ū╚╦▀Ć╩ŪÖCŲ„┤·īæšō╬─Ż¼ų╗ę¬ū÷Ą├ļ[▒╬Ż¼Č╝║▄ļy▒╗░l¼FĪŻ

ĪĪĪĪ╣∙ėóä”▒Ē╩ŠŻ¼æ¬┐╝æ]ĄĮ║▄ČÓ╚╦╣żųŪ─▄«aŲĘęčšµīŹ┤µį┌Ż¼╦³éāš²┐ņ╦┘│╔×ķ╚╦éā╚š│Ż╩╣ė├Ą─╣żŠ▀ĪŻ═¼ĢrŻ¼▀@ą®«aŲĘī”īæū„Ą─ųž┤¾ė░Ēæ┼cø_ō¶▀Ćäéäéķ_╩╝Ż¼─┐Ū░ć°ļHĖ▀Ą╚Į╠ė²Įńī”┤╦╗∙▒Š╔ŽČ╝╠Äė┌╩°╩ų¤o▓▀Ą─ĀŅæBĪŻ▓┐ĘųĖ▀ąŻĄ─Į¹┴Ņ▓ó▓╗─▄šµš²▀_ĄĮą¦╣¹Ż¼Ė³ČÓĖ▀ąŻ│²ųŲČ©║åå╬Ą─║Ļė^ęÄČ©═ŌŻ¼Č╝▀Ć╠Äį┌ė^═¹ĀŅæBĪŻ

ĪĪĪĪ×ķ┤╦Ż¼╣∙ėóä”Į©ūhŻ¼į┌Į¹ų╣╚╦╣żųŪ─▄┤·īæšō╬─ŽÓĻP┴óĘ©ųąŻ¼īó╚╦╣żųŪ─▄┼cīW╬╗šō╬─Ą─ĻPŽĄå╬┴ą│÷üĒū„×ķę╗ĒŚ╝ėęįęÄĘČŻ¼ęį╩ŠŲõųžę¬Ż¼ūī╚╦éā│õĘųšJūRĄĮ╚╦╣żųŪ─▄ī”īWągĄ─╔Ņ┐╠ė░Ēæ;╠ß│÷ę╗éĆųĖī¦ąįęÄĘČęŌęŖŻ¼┤²╬┤üĒĢrÖC│╔╩ņ┐╔ęįį┘ū÷Ė³╝ėįö╝ÜĄ─ą▐ėåĪŻ

ĪĪĪĪ╬─š┬ā╚╚▌āH╣®ķåūxŻ¼▓╗śŗ│╔═Č┘YĮ©ūhŻ¼šłųö╔„ī”┤²ĪŻ═Č┘Yš▀ō■┤╦▓┘ū„Ż¼’LļUūįō·ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮyį┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚└█ėŗ─Żą═öĄ│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįOėŗĪóözė░Īó’LĖ±╗»łDŽ±Ą╚ČÓŅÉą═æ¬ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äōū„’LĖ±ĪŻ

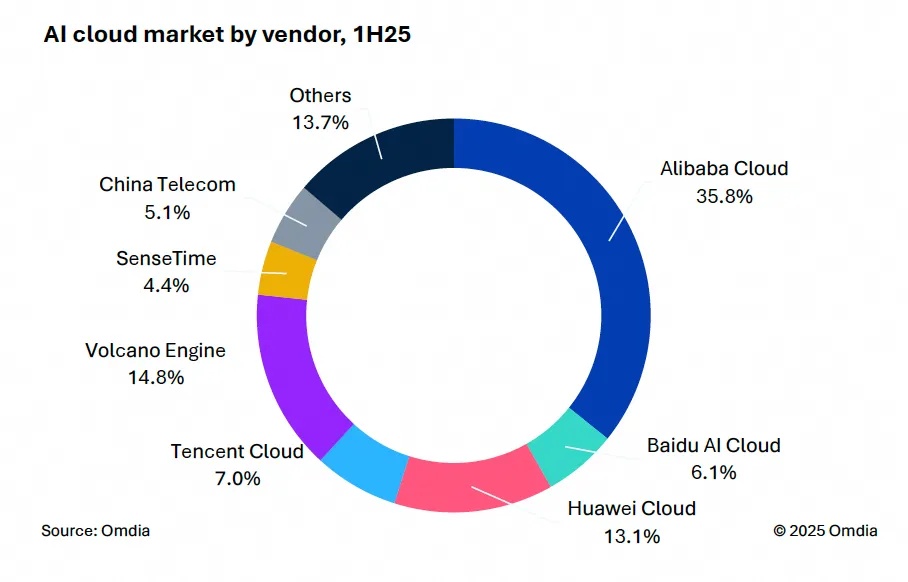

9į┬9╚šŻ¼ć°ļHÖÓ═■╩ął÷š{čąÖCśŗėóĖ╗┬³(Omdia)░l▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI¾w“×╣┘ėŗäØ░l▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖCŻ¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

IDCĮ±╚š░l▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦įOéõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖCŲ„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖä┼Ą─╩ął÷ąĶŪ¾ĪŻ