ĪĪĪĪŪÕ╚A┤¾īW(xu©”)┼cųŪūVAI║Žū„ķ_░l(f©Ī)Ą─CogVLM-17B╩Ūę╗┐Ņć°«a(ch©Żn)ČÓ─ŻæB(t©żi)─Żą═Ż¼Š▀ėąū┐įĮĄ─ąį─▄ĪŻįō─Żą═▓╗āH┐╔ęįūRäełDŽ±ųąĄ─ī”Ž¾Ż¼▀Ć─▄Ęų▒µ═Ļš¹┐╔ęŖ║═▓┐Ęų┐╔ęŖĄ─╬’¾wĪŻ

ĪĪĪĪCogVLM-17BęčĮø(j©®ng)į┌10ĒŚÖÓ(qu©ón)═■┐ń─ŻæB(t©żi)╗∙£╩(zh©│n)╔Ž╚ĪĄ├┴╦SOTA(State-of-the-Art)ąį─▄Ż¼▓óį┌ČÓéĆŅI(l©½ng)ė“│¼įĮ┴╦╣╚ĖĶĄ──Żą═ĪŻ╦³▒╗ą╬Ž¾ĄžĘQ×ķ“14▀ģą╬æ(zh©żn)╩┐”Ż¼š╣¼F(xi©żn)┴╦ŲõČÓ─ŻæB(t©żi)╠Ä└ĒĄ─│÷╔½─▄┴”ĪŻ

ĪĪĪĪįć═µĄžųĘ:

ĪĪĪĪhttps://36.103.203.44:7861

ĪĪĪĪķ_į┤╝░šō╬─ĄžųĘ:

ĪĪĪĪhttps://github.com/THUDM/CogVLM

ĪĪĪĪCogVLM-17B▓╔ė├┴╦¬Ü╠žĄ─╔ŅČ╚╚┌║ŽĘĮĘ©Ż¼═©▀^╦─éĆĻP(gu©Īn)µIĮM╝■īŹ¼F(xi©żn)┴╦łDŽ±╠žš„║═╬─▒Š╠žš„Ą─╔ŅČ╚ī”²RĪŻ▀@ą®ĮM╝■░³└©ViTŠÄ┤aŲ„ĪóMLP▀m┼õŲ„Īó┤¾ą═ŅA(y©┤)ė¢(x©┤n)ŠÜšZčį─Żą═ęį╝░ęĢėXīŻ╝ę─ŻēKĪŻ┼cé„Įy(t©»ng)Ą─£\īėī”²RĘĮĘ©ŽÓ▒╚Ż¼CogVLM-17BĄ─╔ŅČ╚╚┌║ŽĘĮĘ©╠ßĖ▀┴╦ąį─▄Ż¼═¼Ģr▒▄├Ō┴╦╬óš{(di©żo)šZčį─Żą═Ą─╚½▓┐ģóöĄ(sh©┤)┐╔─▄ōp║”NLP╚╬äš(w©┤)ąį─▄Ą─å¢Ņ}ĪŻ

ĪĪĪĪCogVLM-17Bį┌ęĢėXå¢Ņ}ĮŌøQĘĮ├µ▒Ē¼F(xi©żn)│÷╔½Ż¼░³└©ūRäeÅ═(f©┤)ļsł÷Š░ųąĄ─ī”Ž¾Īó╗ž┤ĻP(gu©Īn)ė┌łDŽ±ā╚(n©©i)╚▌Ą─å¢Ņ}ĪóĮŌøQĦłDĄ─ŠÄ│╠Ņ}Ą╚ĪŻ

ĪĪĪĪ┤╦═ŌŻ¼╦³▀Ćš╣╩Š┴╦│÷╔½Ą─╬─ūųūRäe─▄┴”Ż¼▒M╣▄ø]ėąīŻķTĄ─OCRöĄ(sh©┤)ō■(j©┤)▀M(j©¼n)ąąė¢(x©┤n)ŠÜĪŻCogVLM-17BęčĮø(j©®ng)ķ_į┤Ż¼▓ó╠ß╣®┴╦į┌ŠĆįć═µŻ¼ļm╚╗─┐Ū░āHų¦│ųėó╬─Ż¼Ą½ėŗäØį┌╬┤üĒ╠ß╣®ųąėóļpšZ░µ▒ŠĪŻ

ĪĪĪĪ▀@┐Ņć°«a(ch©Żn)ČÓ─ŻæB(t©żi)─Żą═Ą─│÷¼F(xi©żn)Ż¼▓╗āHžSĖ╗┴╦ČÓ─ŻæB(t©żi)ŅI(l©½ng)ė“Ą─╝╝ąg(sh©┤)蹊┐Ż¼▀Ć×ķĖ„ĘNęĢėXå¢Ņ}Ą─ĮŌøQ╠ß╣®┴╦ÅŖ(qi©óng)┤¾Ą─╣żŠ▀ĪŻŲõ╔ŅČ╚╚┌║ŽĘĮĘ©Ą─äō(chu©żng)ą┬ąįś╦(bi©Īo)ųŠų°ČÓ─ŻæB(t©żi)─Żą═ė¢(x©┤n)ŠÜĘČ╩ĮĄ─Ė─ūāŻ¼×ķ╬┤üĒĄ─蹊┐║═æ¬(y©®ng)ė├╠ß╣®┴╦ą┬Ą─╦╝┬Ę║═┐╔─▄ąįĪŻ

ĪĪĪĪ╬─š┬ā╚(n©©i)╚▌āH╣®ķåūxŻ¼▓╗śŗ(g©░u)│╔═Č┘YĮ©ūhŻ¼šłųö(j©½n)╔„ī”┤²ĪŻ═Č┘Yš▀ō■(j©┤)┤╦▓┘ū„Ż¼’L(f©źng)ļUūįō·(d©Īn)ĪŻ

║Żł¾╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮy(t©»ng)į┌ć°ļH╩ął÷╔ŽÅV╩▄║├įuŻ¼─┐Ū░šŠā╚(n©©i)└█ėŗ─Żą═öĄ(sh©┤)│¼▀^80╚féĆŻ¼║Ł╔wīæīŹĪóČ■┤╬į¬Īó▓Õ«ŗĪóįO(sh©©)ėŗĪóözė░Īó’L(f©źng)Ė±╗»łDŽ±Ą╚ČÓŅÉą═æ¬(y©®ng)ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äō(chu©żng)ū„’L(f©źng)Ė±ĪŻ

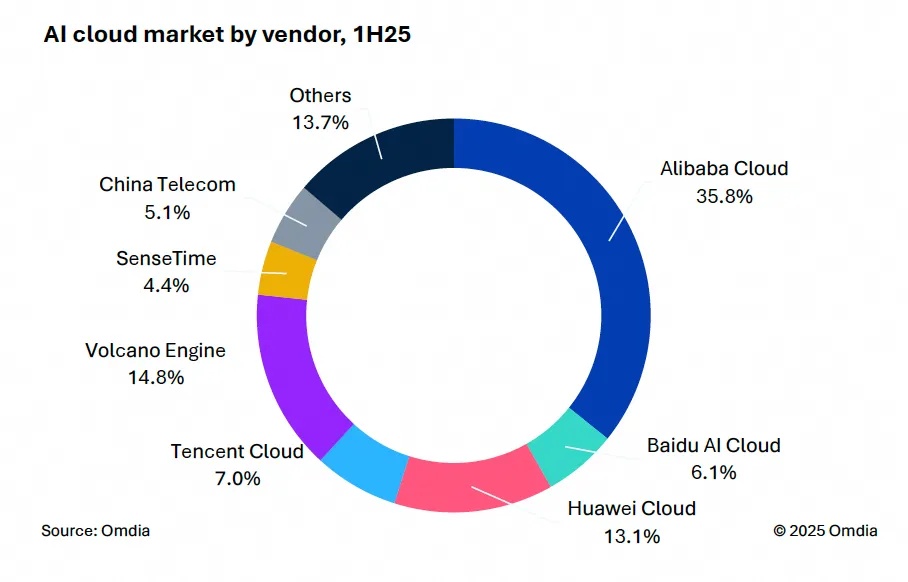

9į┬9╚šŻ¼ć°ļHÖÓ(qu©ón)═■╩ął÷š{(di©żo)čąÖC(j©®)śŗ(g©░u)ėóĖ╗┬³(Omdia)░l(f©Ī)▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“ׯ¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI(y©©)¾w“×╣┘ėŗäØ░l(f©Ī)▓╝Ģ■ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖC(j©®)Ż¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė╚”įŁ└ĒĄ─YH-C3000ĪŻ

IDCĮ±╚š░l(f©Ī)▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦įO(sh©©)éõ╩ął÷╝ŠČ╚Ė·█Öł¾ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦╩ął÷│÷žø1,2╚f┼_Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖ(qi©óng)ä┼Ą─╩ął÷ąĶŪ¾ĪŻ