ĪĪĪĪĮ³Ų┌Ż¼┤¾ą═šZčį─Żą═(LLM)╚ńChatGPT║═Bardį┌╚½Ū“ĘČć·ā╚(n©©i)ę²Ų┴╦ÅVĘ║Ą─ĻP(gu©Īn)ūóŻ¼▒ŖČÓ╣½╦Š═Č┘YöĄ(sh©┤)░┘╚f├└į¬ė├ė┌ķ_░l(f©Ī)▀@ą®╚╦╣żųŪ─▄╣żŠ▀Ż¼Č°ę╗ą®ŅI(l©½ng)Ž╚Ą─AI┴─╠ņÖC(j©®)Ų„╚╦Ą─╣└ųĄęč▀_(d©ó)ĄĮ┴╦öĄ(sh©┤)╩«ā|├└į¬ĪŻ▀@ą®LLMų„ę¬▒╗æ¬(y©®ng)ė├ė┌AI┴─╠ņÖC(j©®)Ų„╚╦Ż¼╦³éā═©▀^š¹║Ž╗ź┬ō(li©ón)ŠW(w©Żng)╔ŽĄ─┤¾┴┐ą┼ŽóüĒīW(xu©”)┴Ģ(x©¬)║═×ķė├æ¶╠ß╣®šłŪ¾Ą─┤░ĖŻ¼▀@ą®šłŪ¾═©│Ż▒╗ĘQ×ķ“╠ß╩Š”ĪŻ

ĪĪĪĪ╚╗Č°Ż¼ūŅĮ³ę╗ĒŚ(xi©żng)ė╔AI░▓╚½│§äō(chu©żng)╣½╦ŠMindgard║═ėóć°╠mķ_╦╣╠ž┤¾īW(xu©”)Ą─ėŗ(j©¼)╦ŃÖC(j©®)┐ŲīW(xu©”)╝ę▀M(j©¼n)ąąĄ─蹊┐Įę╩Š┴╦LLM┤µį┌Ą─ć└(y©ón)ųž┬®Č┤ĪŻčąŠ┐░l(f©Ī)¼F(xi©żn)Ż¼LLMĄ─▓┐Ęųā╚(n©©i)╚▌┐╔ęįį┌▓╗ĄĮę╗ų▄Ą─Ģr(sh©¬)ķgā╚(n©©i)ęįĄ═ų┴50├└į¬Ą─│╔▒Š▒╗Å═(f©┤)ųŲŻ¼▓óŪę½@Ą├Ą─ą┼Žó┐╔ęįė├ė┌░l(f©Ī)äė(d©░ng)ėąßśī”ąįĄ─╣źō¶ĪŻ▀@ą®Øōį┌Ą─╣źō¶š▀┐╔─▄Ģ■(hu©¼)ą╣┬Č╦Į╚╦ÖC(j©®)├▄ą┼ŽóĪó└@▀^░▓╚½▒Żūo(h©┤)┤ļ╩®Īó╠ß╣®Õe(cu©░)š`┤░Ė╗“▀M(j©¼n)ąą▀M(j©¼n)ę╗▓ĮĄ─ėąßśī”ąį╣źō¶ĪŻ

ĪĪĪĪ▀@ĒŚ(xi©żng)├¹×ķ“─Żą═╝─╔·”Ą─╣źō¶ĘĮĘ©═©▀^┼cLLM▀M(j©¼n)ąąĮ╗╗źŻ¼╠ß│÷ę╗ŽĄ┴ąėąßśī”ąįĄ─╠ß╩ŠŻ¼ęį╩╣LLM╠ß╣®╔Ņ╚ļęŖĮŌĄ─ą┼ŽóŻ¼Įę╩Š┴╦─Żą═Ą─╣żū„ĘĮ╩ĮĪŻčąŠ┐łF(tu©ón)ĻĀ(du©¼)į┌蹊┐ųąų„ę¬ĻP(gu©Īn)ūó┴╦ChatGPT-3.5-TurboŻ¼╚╗║¾└¹ė├▀@ę╗ų¬ūR(sh©¬)äō(chu©żng)Į©┴╦ūį╝║Ą─Å═(f©┤)ųŲ─Żą═Ż¼įō─Żą═Ą─┤¾ąĪų╗ėąįŁ─Żą═Ą─1%Ż¼Ą½Å═(f©┤)ųŲ┴╦LLMĄ─ĻP(gu©Īn)µI╠žš„ĪŻčąŠ┐╚╦åTļS║¾└¹ė├▀@éĆ(g©©)─Żą═Ė▒▒Šū„×ķ£yįćŲĮ┼_(t©ói)Ż¼čąŠ┐╚ń║╬į┌▓╗▒╗▓ņėXĄ─ŪķørŽ┬└¹ė├ChatGPTĄ─┬®Č┤ĪŻ╦¹éā│╔╣”Ąž└¹ė├Å──Żą═ųą½@Ą├Ą─ų¬ūR(sh©¬)╣źō¶ChatGPTŻ¼▓ó╠ßĖ▀┴╦11%Ą─│╔╣”┬╩ĪŻ

ĪĪĪĪ╠mķ_╦╣╠ž┤¾īW(xu©”)Ą─Peter Garraghan▓®╩┐▒Ē╩Š:“╬ęéā░l(f©Ī)¼F(xi©żn)Ą─¼F(xi©żn)Ž¾į┌┐ŲīW(xu©”)╔Ž┴Ņ╚╦ų°├įŻ¼Ą½ę▓śOŠ▀ænæ]ĪŻ▀@╩Ū╩ū┤╬īŹ(sh©¬)ūCūC├„░▓╚½┬®Č┤┐╔ęį│╔╣”é„▀fė┌ĘŌķ]į┤║═ķ_į┤Ą─ÖC(j©®)Ų„īW(xu©”)┴Ģ(x©¬)─Żą═ų«ķgŻ¼▀@į┌┐╝æ]ĄĮ«a(ch©Żn)śI(y©©)╚ń║╬ę└┘掱HuggingFace▀@śėĄ─╣½ķ_┐╔ė├ÖC(j©®)Ų„īW(xu©”)┴Ģ(x©¬)─Żą═Ģr(sh©¬)Ż¼┴Ņ╚╦śO×ķō·(d©Īn)ænĪŻ”

ĪĪĪĪ蹊┐╚╦åTųĖ│÷Ż¼▒M╣▄▀@ą®ÅŖ(qi©óng)┤¾Ą─öĄ(sh©┤)ūųAI╝╝ąg(sh©┤)Š▀ėą├„’@Ą─ė├═ŠŻ¼Ą½╦³éā┤µį┌ų°ļ[▓žĄ─╚§³c(di©Żn)Ż¼╔§ų┴▓╗═¼─Żą═ų«ķg┐╔─▄┤µį┌╣▓═¼Ą─┬®Č┤ĪŻĖ„ąąĖ„śI(y©©)Ą─Ų¾śI(y©©)─┐Ū░š²į┌╗“£╩(zh©│n)éõ═Č┘YöĄ(sh©┤)╩«ā|├└į¬ė├ė┌ķ_░l(f©Ī)ūį╝║Ą─LLMŻ¼ęįł╠(zh©¬)ąąĖ„ĘN╚╬äš(w©┤)Ż¼╚ńųŪ─▄ų·╩ųĪŻĮ╚┌Ę■äš(w©┤)║═┤¾ą═Ų¾śI(y©©)ę▓į┌▓╔ė├▀@ą®╝╝ąg(sh©┤)Ż¼Ą½čąŠ┐╚╦åT▒Ē╩ŠŻ¼▀@ą®┬®Č┤æ¬(y©®ng)įō│╔×ķėŗ(j©¼)äØśŗ(g©░u)Į©╗“╩╣ė├Ą┌╚²ĘĮLLMĄ─╦∙ėąŲ¾śI(y©©)Ą─ų„ę¬ĻP(gu©Īn)Ūą³c(di©Żn)ĪŻ

ĪĪĪĪPeter Garraghan▓®╩┐ÅŖ(qi©óng)š{(di©żo):“ļm╚╗LLM╝╝ąg(sh©┤)Š▀ėąØōį┌Ą─ūāĖ’ąįŻ¼Ą½Ų¾śI(y©©)║═┐ŲīW(xu©”)╝ęČ╝▒žĒÜūą╝Ü(x©¼)┐╝æ]▓╔ė├║═▓┐╩LLM╦∙╔µ╝░Ą─ŠW(w©Żng)Įj(lu©░)░▓╚½’L(f©źng)ļU(xi©Żn)ĪŻ”▀@ĒŚ(xi©żng)蹊┐×ķ╬ęéā╠ßąč┴╦ļm╚╗AI╝╝ąg(sh©┤)ĦüĒ┴╦Š▐┤¾Ą─ÖC(j©®)Ģ■(hu©¼)Ż¼Ą½ę▓░ķļSų°ę╗ŽĄ┴ąØōį┌Ą─═■├{Ż¼ę“┤╦▒žĒÜųö(j©½n)╔„ąą╩┬ĪŻ

ĪĪĪĪ╬─š┬ā╚(n©©i)╚▌āH╣®ķåūxŻ¼▓╗śŗ(g©░u)│╔═Č┘YĮ©ūhŻ¼šłųö(j©½n)╔„ī”┤²ĪŻ═Č┘Yš▀ō■(j©┤)┤╦▓┘ū„Ż¼’L(f©źng)ļU(xi©Żn)ūįō·(d©Īn)ĪŻ

║Żł¾(b©żo)╔·│╔ųą...

║Ż╦ćAIĄ──Żą═ŽĄĮy(t©»ng)į┌ć°ļH╩ął÷╔ŽÅV╩▄║├įu(p©¬ng)Ż¼─┐Ū░šŠā╚(n©©i)└█ėŗ(j©¼)─Żą═öĄ(sh©┤)│¼▀^80╚féĆ(g©©)Ż¼║Ł╔wīæīŹ(sh©¬)ĪóČ■┤╬į¬Īó▓Õ«ŗĪóįO(sh©©)ėŗ(j©¼)Īóözė░Īó’L(f©źng)Ė±╗»łDŽ±Ą╚ČÓŅÉą═æ¬(y©®ng)ė├ł÷Š░Ż¼╗∙▒ŠĖ▓╔w╦∙ėąų„┴„äō(chu©żng)ū„’L(f©źng)Ė±ĪŻ

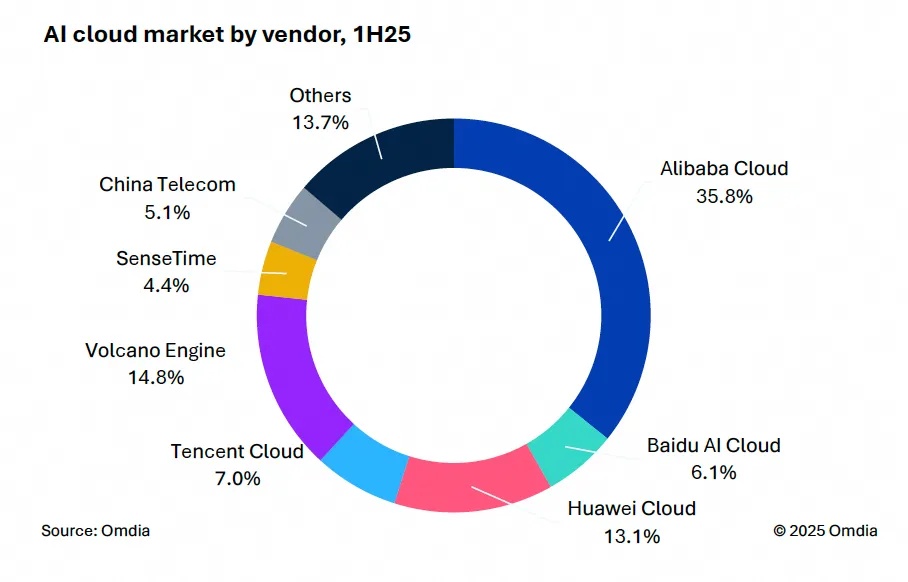

9į┬9╚šŻ¼ć°ļHÖÓ(qu©ón)═■╩ął÷š{(di©żo)čąÖC(j©®)śŗ(g©░u)ėóĖ╗┬³(Omdia)░l(f©Ī)▓╝┴╦ĪČųąć°AIįŲ╩ął÷Ż¼1H25ĪĘł¾(b©żo)ĖµĪŻųąć°AIįŲ╩ął÷░ó└’įŲš╝▒╚8%╬╗┴ąĄ┌ę╗ĪŻ

9į┬24╚šŻ¼╚A×ķ└żņ`š┘ķ_Ī░ųŪ─▄¾w“×(y©żn)Ż¼ę╗Ų┴ĄĮ╬╗Ī▒╚A×ķIdeaHubŪ¦ąą░┘śI(y©©)¾w“×(y©żn)╣┘ėŗ(j©¼)äØ░l(f©Ī)▓╝Ģ■(hu©¼)ĪŻ

č┼±R╣■ū“╚šą¹▓╝═Ų│÷ā╔┐ŅŅ^┤„╩ĮČ·ÖC(j©®)Ż¼Ęųäe╩ŪŲĮ░Õš±─żĄ─YH-4000║═äė(d©░ng)╚”įŁ└ĒĄ─YH-C3000ĪŻ

IDCĮ±╚š░l(f©Ī)▓╝Ą─ĪČ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦įO(sh©©)éõ╩ął÷╝ŠČ╚Ė·█Öł¾(b©żo)ĖµŻ¼2025─ĻĄ┌Č■╝ŠČ╚ĪĘ’@╩ŠŻ¼╔Ž░ļ─Ļ╚½Ū“ųŪ─▄╝ęŠėŪÕØŹÖC(j©®)Ų„╚╦╩ął÷│÷žø1,2╚f┼_(t©ói)Ż¼═¼▒╚į÷ķL33%Ż¼’@╩Š│÷ŲĘŅÉÅŖ(qi©óng)ä┼Ą─╩ął÷ąĶŪ¾ĪŻ